3年前にこんな話を書いたわけですが、皆さんご記憶でしょうか。

この当時は「平均への回帰」という言葉にその不毛さを託したわけですが、前回の記事に着想を得てもう少し今時っぽく論じることが出来るんじゃないかと思ったので、ちょっと書いてみようかと思います。

なお、言うまでもありませんが以下に示す例は完全に単なるシミュレーションであり、特定の事例を意味するものではありません*1。過去にデータ分析業界の内部で見聞された数々の事例の最大公約数的な部分をベンチマークとしてまとめたものとご理解下されば幸いです。またシミュレーション自体も特に数理的な厳密さを期したものではありませんので、そこもご了承あれ*2。

ビジネスの現場でよくある光景

一般に「PDCAサイクルをとにかく速く回す」のがビジネスを成功させる近道だと言われるわけです。そこで、こんなケースを考えてみます。設定としては、何かしらのeCommerceサービスの売上高を向上させるための意思決定というシーン。PCサイトやモバイルサイト・アプリからは様々なデータの測定が可能で、さらにマーケティング部隊が持ち込んでくる社外のデータと合わせて、意思決定や日々の施策実行の参考にできるというシチュエーションを仮定します*3。

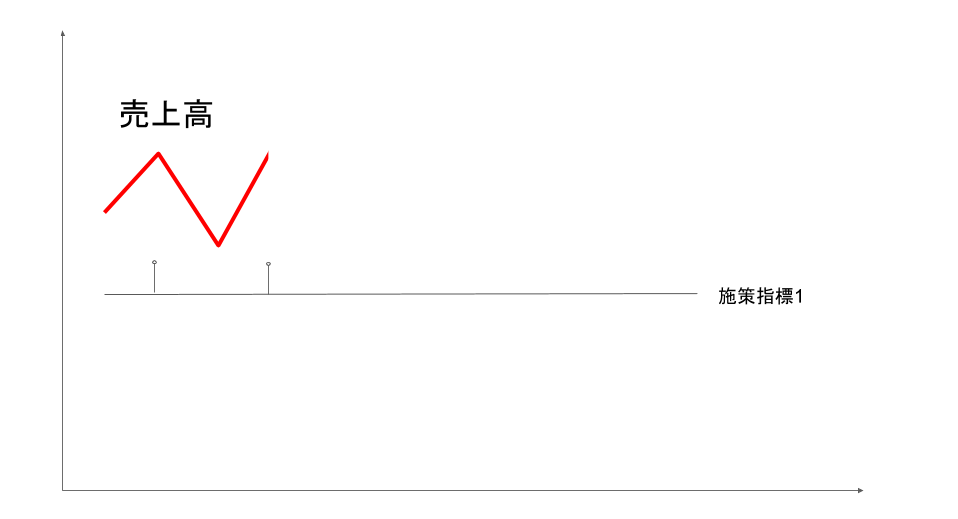

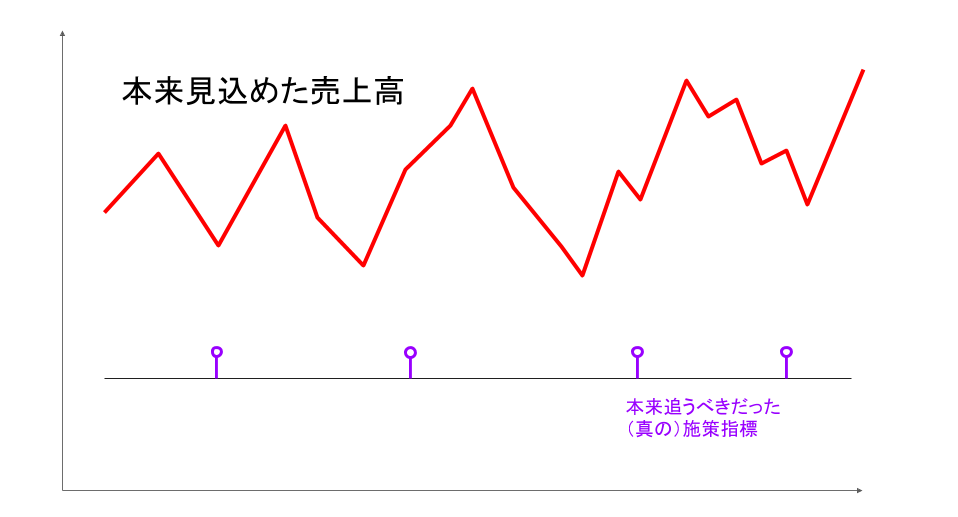

ある週の月曜の朝会で、こんな売上高と関連指標が示されたとします。

見た感じ、施策指標1を追って施策を打つと売上高が上がりそうに見えます。「よし、指標1を追うように施策を打つぞ!」とマネージャーが号令をかけたとしましょう。

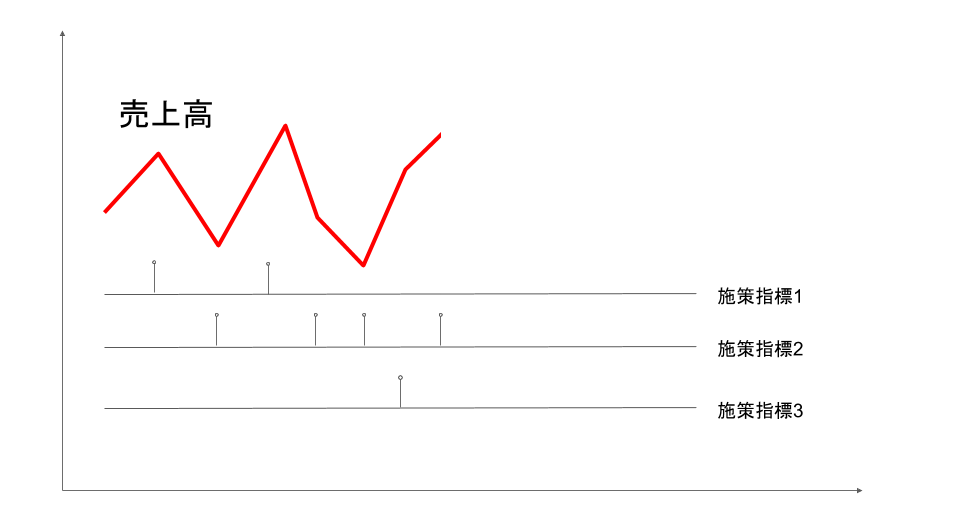

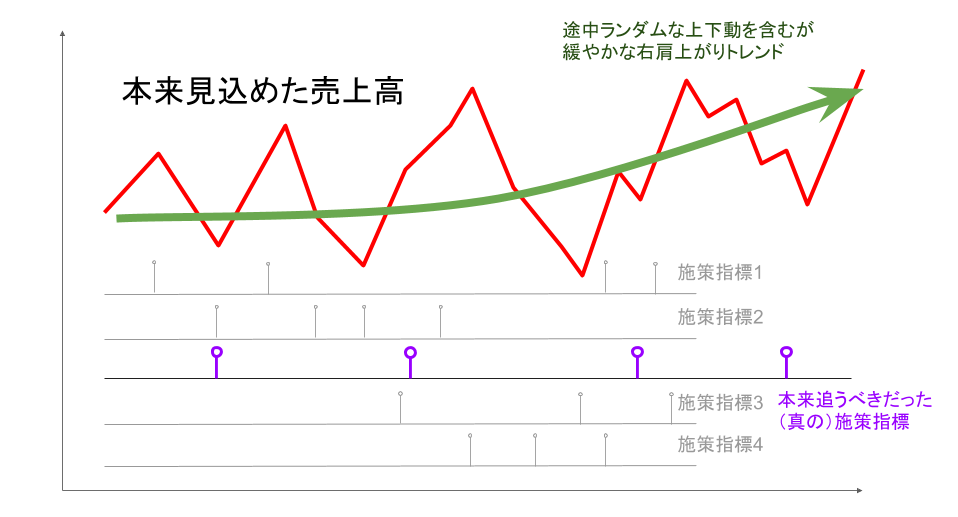

その次の週の月曜朝会では、こんな感じのデータが示されたとします。

施策1は効いているようですが、どうやら指標2が売上高を引き下げる方向に作用しているようです。「よし、指標2を踏まないような施策を打つぞ!」とマネージャーが号令をかけたとします。

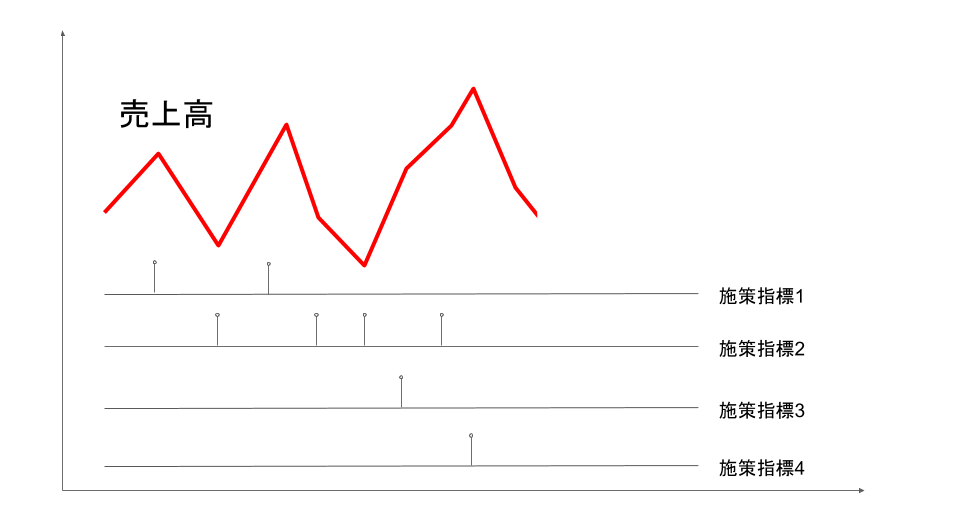

そのまた次の週の月曜朝会では、こんな感じのデータが出てきました。

施策1は効いているように見え、施策2で売上高引き下げにかかりそうな悪影響を何とか回避できているように見え、新たに指標3を追うと大幅に売上高が伸びそうな印象があります。「よし、さらに指標3を追うぞ!これで一気に売上が伸ばせる!」とマネージャーは意気軒昂。

さらにそのまた次の週の月曜朝会で、今度はこんな感じのデータが。

マネージャーが声を荒げて曰く「おい!施策3はどうしたんだ?それにこの指標4は何だ???」。確かに施策3が抜けている上に、指標4は売上高の大幅ダウンを予測しているように見えます。慌てて施策3を多発し、指標4を回避するための施策を打ってみることになりました。

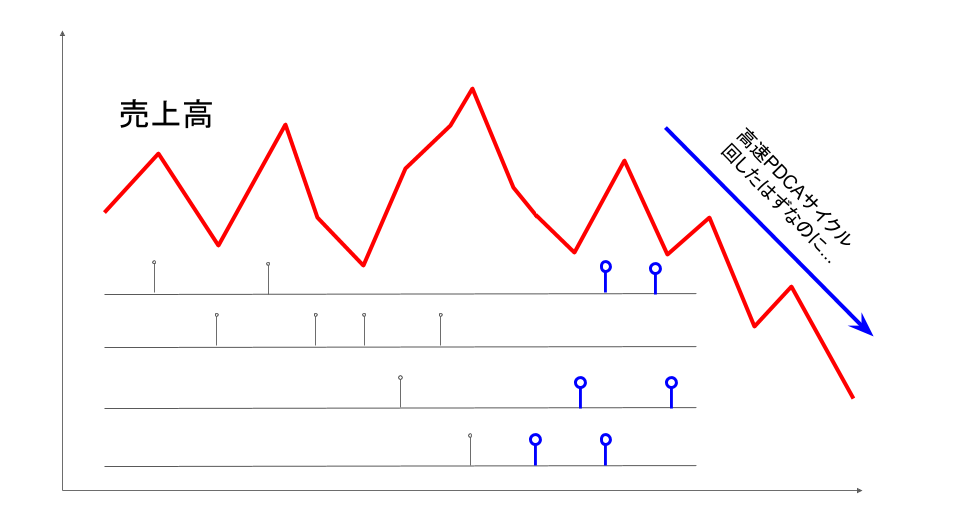

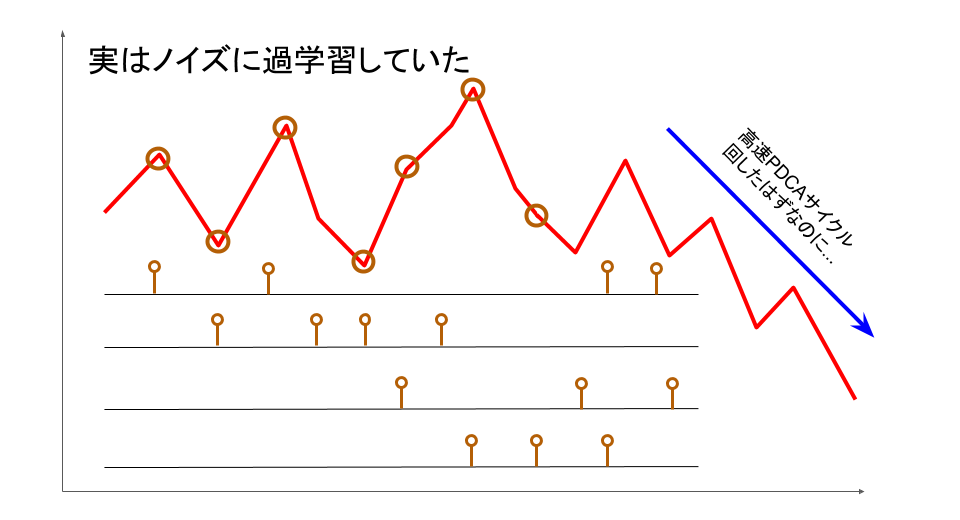

それからしばらく経って、振り返ってみたら売上高はこうなっていました。

「何じゃこりゃあ。。。俺たち毎週データを見ながら高速でPDCA回してたはずなんだよなぁ。何で売上高下がってるんだよ???」とぼやくマネージャー。何故か右肩下がりで落ちていく売上高に言葉もない様子です。。。

とまぁ、これはあくまでも単なる架空のビジネスシーンの話ですが、これに近い話を思った以上に色々なところから聞きます。一生懸命頑張って即応できる体制を作り、一分一秒を争って次々にマーケティング施策・集客施策を打っているのに、何故かビジネスパフォーマンスにつながらない。それどころか下がっていってしまうことすらある。。。これは一体どういうことなんでしょうか?

見えるデータの裏側で実際に起きていること

上の例に関して言えば、割とありがちなのが以下のようなパターンです。

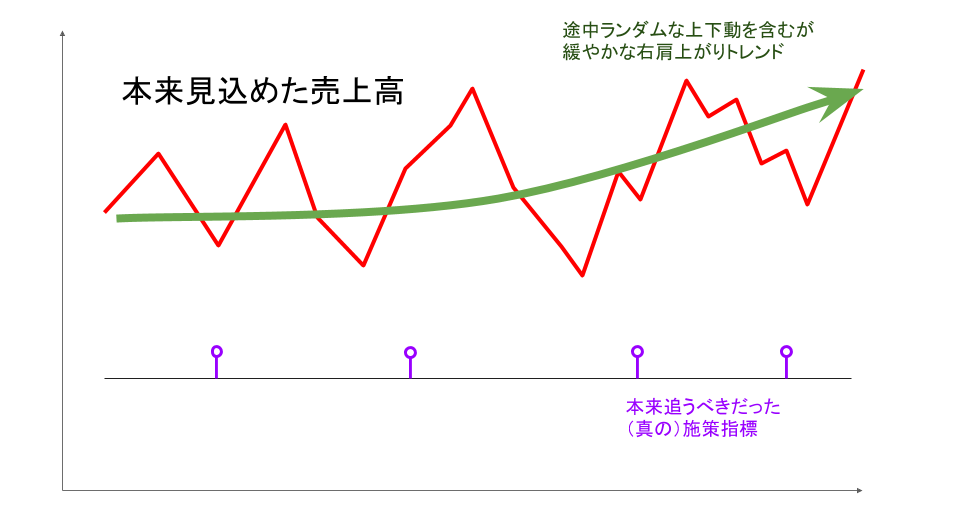

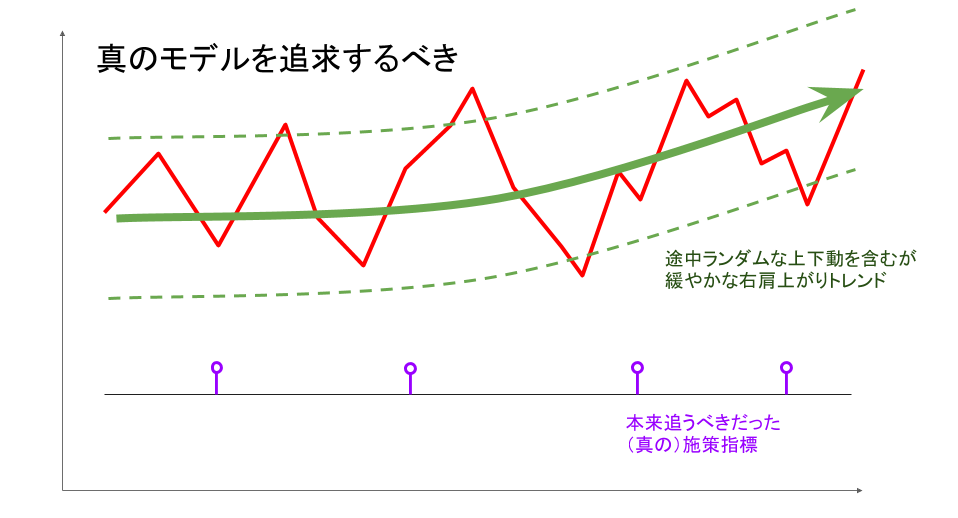

実は、適切な指標を追って施策を打っていればもっと高い売上高が望めました、みたいなケースというのは珍しくありません。しかも、実は指標を追う「タイミング」(頻度)が重要だった、みたいなこともあったりします。例えば以下のような感じに。

その適切な指標が実は長期的視点で見ないと気付かれない上に*4、それがまさに長期トレンドの先行指標だった、なんて悲しい話をたまに聞くことがあります。そして、そういう指標に限ってさらに間の悪いことにこれまで追いかけてきた短期指標とは全然関係がなかったりするんですよね。。。

こうなると、どう頑張ってもどうにもならないわけです。では、何故このような事態を現場の人々は防げなかったのでしょうか?

PDCAサイクルを速く回すこと「だけ」にこだわった結果

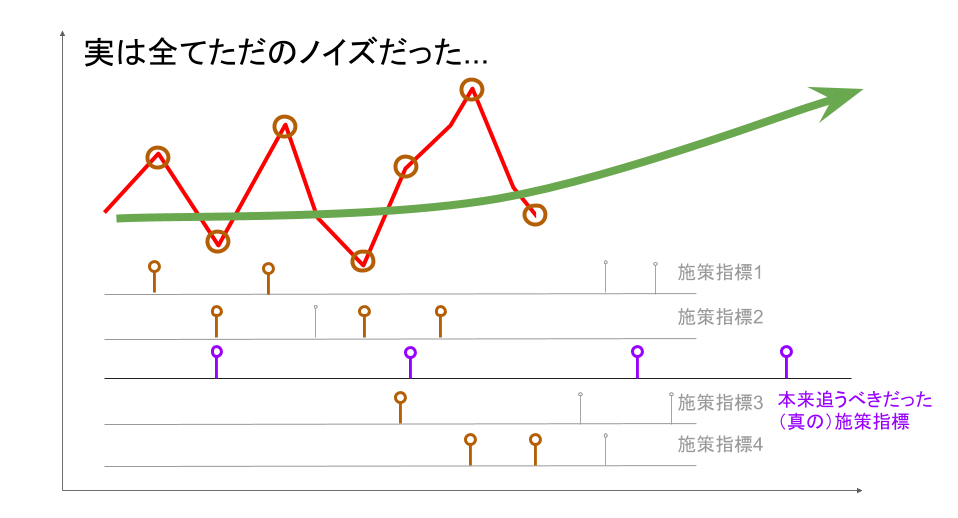

もちろん「PDCAサイクルを速く回していたにもかかわらずうまくいかない」理由なんて他にも山ほどありますが、この手のケースでありがちなのは「実はノイズにばかり気を取られてしまった」からだったりします。

当たり前ですが、ノイズに過学習して施策を決めていたら何の効果もありません。効果がないだけならまだマシで、もしかしたら何かしらのマイナスをもたらしているかもしれません。かくして、過学習した意思決定モデルのもとでは何をやってもうまくいかなくなる、というわけです。

一般に、この手のマーケティング系のデータで短期に見えてくる上下動の多くは何かしらの瑣末な要因によるノイズ*5であることが多いと個人的には認識しています。なので、闇雲にPDCAサイクルを高速に回す=短期的なデータ変動に基づいての意思決定・変更を頻繁に繰り返すと、これらのノイズに振り回されることになりやすい、というのが僕の見立てです。

そして、マーケティング系のデータの中でも最終的な売上高・利益などのKGIは概して長期的な上下動を伴います*6。なので、これに先行する指標があるとすれば、それもまた長期的・大局的な上下動を見せると考えた方が無難です。意思決定のために精緻に追うべき指標を選ぶならば、こちらの方が重要でしょう。

あくまでも長期的な上下動を反映するようなモデルに基づいて意思決定する方が、最終的には売上高・利益などのKGIの向上を図る上では有用だろうというのが僕の意見です。なお、細かい話で言うとマーケティングデータの多くは曜日・月・四半期・年などの季節調整を伴い、さらに言うとローカル線形トレンド(一階差分トレンド)なども含むため、これらを除去した上で色々考えなければいけないという側面もあります。実際に大事なのはその先に残る定常過程部分だったり、もしくは二階差分トレンド部分だったりすることもあります。

ヒトの意思決定すら「ノイズに過剰に適合する=過学習する」かもしれないということ

前回の記事では交差検証をしないがために過学習されたモデルにハマってしまうという話を取り上げました。

けれども、実際にはこうしてきちんと統計学や機械学習に基づいたモデルに基づかない、完全に純粋なヒトの意思決定のレベルであっても、上記のシミュレーションのようにノイズに過剰に適合して過学習を起こすことがあり得る、と僕個人は睨んでいます。そして、そういうケースに限って「うまくいかないならもっと色々試してみなければ」という心理状態に陥りやすく、さらに過学習を起こすような要素を増やしてしまい、なかなかvicious cycleから脱却できないということになりがちだという印象を持っています。

今回示したのは完全に架空のシミュレーションながら、そういう場合に必要なのは「一度落ち着いて長期トレンドをしっかり見極める」すなわち目先のノイズに振り回されないスタンスを持つということなのかな、と思う次第です。ただしそれは同時に「短期的な損失には動じない」という覚悟も求められることなので、ビジネス上の意思決定を担う人たちには物凄くつらいかもしれません。。。とは言え、「高速PDCAサイクルを回しているのになかなか業績が好転しない」とお悩みの現場にはこういう考え方を持ち込むのもアリなのでは?と考えております。